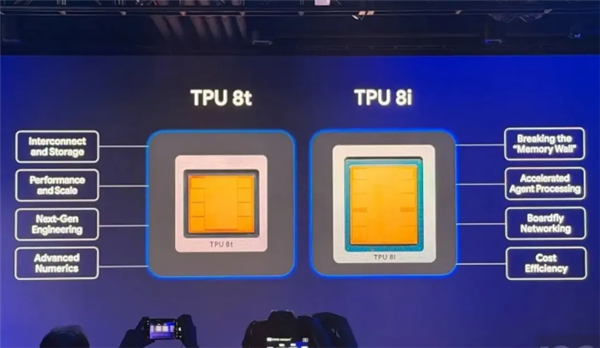

快科技4月23日消息,谷歌云2026 Next大会召开,谷歌正式发布了第八代张量处理器(TPU)。这是谷歌史上首次将AI训练与推理任务拆分至两款独立芯片——专为模型训练设计的TPU 8t与专为推理优化的TPU 8i,标志着其AI硬件战略的重大调整。

这一战略转变的根本原因在于AI计算负载的日益分化。谷歌AI与基础设施高级副总裁兼首席技术官Amin Vahdat在官方博客中指出:“随着AI智能体的兴起,我们确信业界将受益于针对训练和推理需求分别进行专门优化的芯片。”

具体而言,训练任务追求极致的吞吐量与规模扩展能力,需要芯片具备最高的计算密度和内存带宽,以在数周甚至数月内处理万亿级参数。

而推理任务则对延迟和并发更为敏感——当数百万个AI智能体同时运行时,响应速度至关重要,而对峰值算力的要求相对较低。

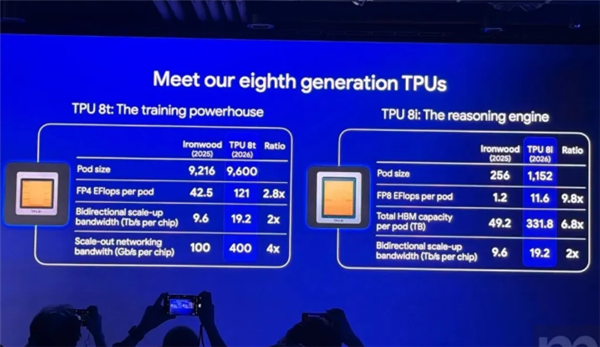

TPU 8t由谷歌与博通共同设计,是谷歌为超大规模AI模型训练打造的旗舰芯片。单个超级计算节点最多可集成9600块TPU 8t芯片,配备2 PB高带宽内存,每Pod计算性能达121 exaflops(FP4精度),较上一代Ironwood提升约3倍,同等价格下性能提升2.8倍。通过JAX与Pathways框架,可将分布式训练扩展至单一集群超过100万块芯片。

TPU 8i首次由谷歌与联发科合作设计,专注于AI推理场景,旨在消除“等待室效应”——即用户请求被有意排队或延迟以实现硬件利用率最大化的情况。单个Pod可扩展至1152块芯片,提供11.6 exaflops FP8计算性能,较Ironwood同等价格下性能提升80%,每瓦性能较上一代提升117%。

两款第八代TPU芯片均搭载了谷歌自研的Arm架构Axion CPU作为主控,彻底解决数据预处理延迟导致的主机算力瓶颈。芯片采用台积电2nm制程工艺制造,目标在2027年底量产,并由谷歌第四代液冷技术支持散热。

在软件生态方面,第八代TPU支持JAX、PyTorch、Keras及vLLM等主流框架,原生PyTorch支持现已进入预览阶段,用户可直接迁移模型而无需修改代码。

除了硬件,谷歌还发布了Gemini Enterprise Agent Platform及一系列AI代理工具。新增的Memory Bank和Memory Profile功能,可以帮助AI代理记住与用户的过往互动;Agent Simulation则能让开发者在工具发布前测试其运行情况。谷歌的核心目标是帮助企业实现任务自动化,让AI代理真正成为企业的“数字员工”。

AI代理是当前AI应用的重要方向。与传统的聊天机器人不同,AI代理可以自主完成复杂任务,比如预订行程、管理日程、处理邮件等。谷歌的这一系列工具将大大降低企业部署AI代理的门槛。

原创文章,作者:admin,如若转载,请注明出处:http://www.kandianxun.com/internet/88380.html